Yapay zeka sistemleri metinleri, kelimeleri veya karmaşık kurumsal dokümanları insan zihninin algıladığı gibi okuyup anlayamazlar. Onlar için her şey matematiksel bir düzlemden ve sayısal ifadelerden ibarettir. Kendi sistemlerinizi kurarken, bir arama motorunu optimize ederken veya şirketinizin bilgi tabanını bir yapay zeka asistanına entegre ederken karşınıza çıkacak en temel ve en kritik yapı “Embedding” (gömme) teknolojisidir. Geleneksel arama motorlarının yıllarca kullandığı kelime eşleştirme mantığı, 2026 yılı itibarıyla yerini tamamen cümlenin ardındaki niyeti ve bağlamı anlayan semantik arama sistemlerine bırakmıştır. Bu dönüşümün kalbinde yer alan embedding modelleri, kelimelerin ve dokümanların ardındaki gizli anlam haritasını çıkararak günümüzün Retrieval-Augmented Generation (RAG) mimarilerine hayat vermektedir.

Sizlerin de kurumsal projelerinizde veya kişisel veri analizi süreçlerinizde deneyimlediğiniz üzere, klasik arama sistemleri “iade koşulları” aramasına yanıt olarak, içerisinde sadece “iade” ve “koşullar” kelimeleri geçen ilgisiz sayfaları listeleyerek büyük bir hayal kırıklığı yaratabilmektedir. Oysa modern bir embedding modeli, kullanıcının “ürünümü nasıl geri verebilirim?” şeklindeki sorgusunun, “iade koşulları” ile tamamen aynı anlama geldiğini bilir ve kelimeler hiç eşleşmese bile en doğru dokümanı saniyeler içinde karşınıza çıkarır. Bu kılavuzda, embedding teknolojisinin detaylarına inecek ve en iyi açık kaynaklı embedding modellerini listeleyeceğiz.

Yapay Zekanın Anlam Haritası: Embedding Nedir, Nasıl Çalışır?

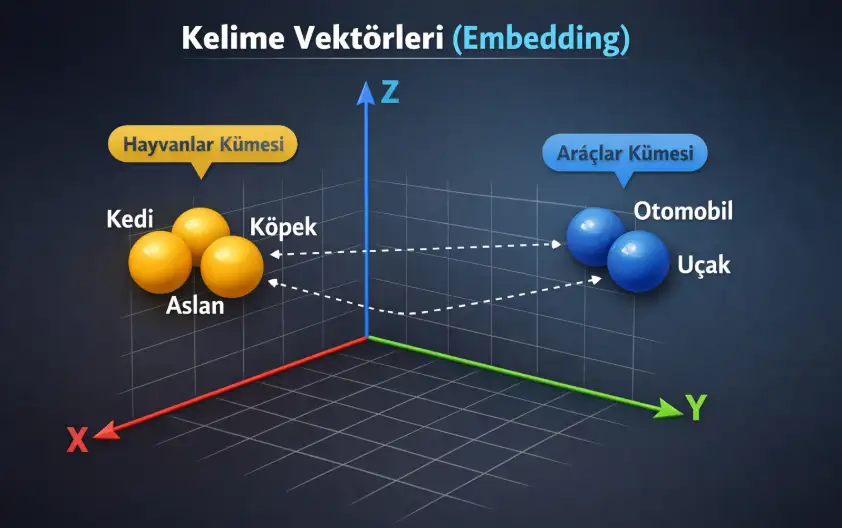

En yalın tanımıyla embedding; bir kelimenin, cümlenin, paragrafın veya saatler süren bir video dosyasının, yapay zekanın anlayabileceği çok boyutlu bir matematiksel uzayda sayısal olarak temsil edilmesidir. Bu sayısal temsil, düzensiz veri noktalarını alıp, anlamsal özelliklerini koruyarak onları yoğun bir sayı dizisine dönüştürme işlemidir. Embedding modellerinin temel gayesi, anlamsal olarak birbirine benzeyen veri noktalarını bu sonsuz boyutlu vektör uzayında birbirine yakınlaştırmak, anlamsal olarak ilgisiz olanları ise birbirinden fersah fersah uzaklaştırmaktır.

Bu sistemi daha iyi kavrayabilmek için klasik bir örnek üzerinden ilerleyelim. Sadece dört kelimeden oluşan bir dünyamız olduğunu varsayın: kraliçe, kral, prenses ve prens. Eski nesil sistemlerde (örneğin One-Hot Encoding yöntemiyle), her kelimeye bir sütun atanır ve devasa bir sıfırlar ve birler tablosu oluşturulurdu. Bu seyrek vektör yapısında “kral” ve “prens” arasındaki anlamsal bağ tamamen yok olurdu. Modern embedding mimarilerinde ise bu kelimeler “cinsiyet” ve “yaş/statü” gibi gizli boyutlar üzerinden sayılara dönüştürülür. Vektör uzayında “kral” kelimesinden “erkek” anlamını çıkarıp “kadın” anlamını eklediğinizde, ulaştığınız koordinat sizi kusursuz bir şekilde “kraliçe” kelimesine götürür. İşte yapay zekanın “anlaması” dediğimiz mucize, bu matematiksel vektör manipülasyonundan başka bir şey değildir.

Endüstriyel ölçekteki sistemlerde bu temsiller sadece birkaç kelimeyle sınırlı kalmaz. Vektör embedding çok farklı formatlarda ve ihtiyaçlarda üretilebilir:

- Sistemlerin kelimeler arası temel ilişkileri kurmasını sağlayan kelime embeddingleri, doğal dil işlemenin temelini atar. Ancak RAG gibi gelişmiş bilgi geri çağırma sistemlerinde kelimelerden ziyade cümle ve doküman embeddinglerine ihtiyaç duyulur. Bu modeller, koca bir faaliyet raporunu veya teknik şartnameyi alıp bağlamı ve niyeti tek bir vektöre sıkıştırır. Günümüzde standart hale gelen multimodal embeddingler karşımıza çıkmaktadır. Bu sistemler, sadece metinleri değil, görselleri, grafikleri ve ses dosyalarını aynı anlamsal vektör uzayına yerleştirir. Bu sayede bir kullanıcı “şelale sesleri” yazdığında, sistem metin ile eşleşen bir ses dosyasını aynı uzayda bulup getirebilmektedir.

Bir embedding modelinin ürettiği sayı dizisinin uzunluğuna “boyut” adı verilir. 2026 yılının modern gömme modelleri genellikle 384, 768, 1024 veya 4096 boyutlu vektörler üretmektedir. Bu durumu şu şekilde düşünebilirsiniz: Model, verdiğiniz bir metni 4096 farklı anlamsal açıdan (örneğin tonu, konusu, geçmiş zaman kipi mi olduğu, teknik terim içerip içermediği vb.) değerlendirerek her bir açı için bir puan atar. Boyut sayısı ne kadar yüksekse, model metinler arasındaki en ince nüansları o kadar iyi yakalayabilir. Ancak yüksek boyutlu vektörler, sistemlerinizin bellek tüketimini artırır ve arama hızınızı düşürür.

Bu vektörlerin birbirine ne kadar benzediğini hesaplamak için sistemler “Kosinüs Benzerliği” adı verilen bir matematiksel formül kullanır. İki vektör uzayda aynı yönü gösteriyorsa aralarındaki açı sıfırdır ve kosinüs benzerlik skoru 1’e (mükemmel eşleşme) yaklaşır. Eğer vektörler birbirine dikse (ilgisizse) skor 0 olur, tamamen zıt yönleri gösteriyorsa skor -1 olur. Arama motorları ve RAG mimarileri, kullanıcının sorusunu bir vektöre çevirip, veritabanındaki milyonlarca doküman vektörü arasından kosinüs benzerliği en yüksek olan (yani açısal olarak en yakın olan) dokümanları milisaniyeler içinde çekip getirir.

Gelişmiş öneri sistemleri de tam olarak bu mantıkla çalışır. Netflix veya Spotify gibi platformlarda sizin kullanıcı profiliniz bir vektör olarak ifade edilir. İzlediğiniz veya dinlediğiniz içerikler de aynı uzayda birer vektördür. Sistem, sizin vektörünüze en yakın olan içerik vektörlerini bularak karşınıza “Bunları da beğenebilirsiniz” başlığı altında çıkarır.

En İyi Açık Kaynak Embedding Modelleri

Piyasadaki her modelin kendine has bir karakteri, mimari yaklaşımı ve optimum kullanım senaryosu bulunmaktadır. RAG hattınızı veya semantik arama motorunuzu tasarlarken doğru modeli seçmek, projenin kaderini belirler. Bu bölümde, sektörün zirvesinde yer alan en güçlü açık kaynaklı modellerini listeledik:

| Model Adı | Sağlayıcı ve Lisans | MTEB Multilingual Skor | Bağlam Penceresi (Token) | Vektör Boyutu (Dimension) |

| Qwen3-Embedding-8B | Alibaba (Apache 2.0) | 70.58 | 32,000 | 32 – 4096 (MRL Esnek) |

| Llama-Embed-Nemotron-8B | NVIDIA (NVIDIA Open) | 68.69 | 128,000 | 4096 |

| Gemini Embedding-001 | Google Cloud (Tescilli) | 68.32 | 2,048 | Bilinmiyor |

| GTE-Qwen2-7B-Instruct | Alibaba NLP (Apache 2.0) | 67.20 | 32,000 | 3584 |

| Voyage-3-Large | Voyage AI (Tescilli) | 67.20 | 32,000 | Bilinmiyor |

| Jina-Embeddings-v5-small | Jina AI (Açık Kaynak) | ~67.00 | 32,768 | 1024 (MRL Esnek) |

| BGE-M3 | BAAI (MIT) | 63.00 | 8,192 | 1024 |

| Text-Embedding-3-Large | OpenAI (Tescilli) | 64.60 | 8,192 | 3072 |

1. Qwen3-Embedding Serisi

Alibaba Qwen ekibi tarafından geliştirilen ve 2026 yılında MTEB çok dilli liderlik tablosunun zirvesine 70.58 gibi olağanüstü bir skorla oturan Qwen3-Embedding-8B, endüstride deprem etkisi yaratmıştır. 8 milyar parametreli bu devasa model, 100’den fazla doğal dili ve programlama dilini ana dili gibi anlayabilmektedir.

Qwen3’ün bu kadar başarılı olmasının ardında yatan temel neden, çift yönlü dikkat mekanizmalarını entegre etmesi ve bağlamsal anlayışını muazzam ölçüde zenginleştirmesidir. Standart modeller sadece soldan sağa doğru bir okuma yaparken, Qwen3 cümlenin sonundaki bir kelimenin, cümlenin başındaki bağlamı nasıl değiştirebileceğini aynı anda analiz eder. Sistem ayrıca, işlem verimliliğini artırmak için “instruction tuning” işlemini yalnızca kullanıcı sorgusu tarafında uygular.

Modelin en devrimsel özelliklerinden biri 32.000 tokenlik devasa bağlam penceresidir. Bu sayede hukuki metinler veya uzun bilimsel makaleler küçük parçalara bölünmeden bütüncül bir şekilde vektör uzayına aktarılabilmektedir. Qwen3 ayrıca Matryoshka Representation Learning (MRL) mimarisine tam destek verir. 4096 boyutlu devasa çıktıları, anlamsal kalitesinden neredeyse hiçbir şey kaybetmeden 32 boyuta kadar küçültülebilir. Bu özellik veritabanınızda %90’a varan yer tasarrufu sağlar. Kısıtlı donanımlara sahip projeler için ailenin küçük üyesi olan Qwen3-Embedding-0.6B versiyonu bile, MTEB testlerinde eski nesil birçok büyük modeli geride bırakmayı başarmıştır.

2. Llama-Embed-Nemotron-8B

NVIDIA’nın Meta’nın Llama 3.1 mimarisi üzerine inşa ederek Ekim 2025’te piyasaya sürdüğü ve 2026’da güncellediği Llama-Embed-Nemotron-8B, tam anlamıyla bir “bilgi geri çağırma” canavarıdır. Model, 128.000 tokenlik akıl almaz bir bağlam uzunluğunu destekleyerek, kitap uzunluğundaki teknik dökümanların tek seferde işlenmesine imkan tanır.

Modelin mimarisi “Bi-encoder” yapısına dayanır ve Karşılaştırmalı Öğrenme metoduyla eğitilmiştir. Eğitim aşamasında NVIDIA, 16 milyonluk devasa bir veri seti kullanmıştır (8 milyon açık kaynaklı veri, 8 milyon sentetik veri). Bu eğitim stratejisinde sisteme bir soru, bu sorunun doğru cevabını içeren bir paragraf (positive) ve cevaba çok benzeyen ama aslında yanlış olan zorlayıcı paragraflar (hard negatives) verilir. Model, doğru cevapla sorunun benzerliğini maksimize ederken, yanıltıcı metinlerle olan uzaklığı maksimize etmeyi öğrenir.

Bağımsız e-ticaret analizlerinde ve MTEB Borda Rank (genel dayanıklılık ve ortalama başarı sıralaması) metodolojisinde 1. sıraya yerleşen Nemotron, Amazon ürün incelemeleri üzerinde yapılan gerçek dünya testlerinde “Top-1 Accuracy” (Doğru belgeyi en üst sırada, 1. sırada getirme başarısı) konusunda %62’lik oranla kendisinden kat kat büyük modelleri bile alt etmiştir. Kurumsal RAG sistemlerinde, eğer kullanıcılarınızın ilk tıkladığı belgenin kesinlikle doğru olması gerekiyorsa, Nemotron-8B piyasadaki en güçlü adaydır.

3. Jina Embeddings v5

Jina AI tarafından geliştirilen Jina-embeddings-v5 ailesi (Small ve Nano versiyonları), “text distilling” teknolojisi ile milyar parametre altı (<1B) modeller sınıfında kuralları yeniden yazmıştır. Jina-v5-text-small sadece 677 milyon parametreye, Nano versiyonu ise 239 milyon parametreye sahip olmasına rağmen, 32.768 tokenlık bağlam işleyebilir ve MTEB testlerinde kendi boyutunun iki katı büyüklükteki modelleri geride bırakır.

Mühendislik perspektifinden Jina v5’i devrimsel kılan iki ana özellik vardır: Birincisi, GOR (Gradient Orthogonalization Regularization) optimizasyonuyla eğitilmiş olmasıdır. Bu optimizasyon sayesinde modelin ürettiği vektörler “Binary Quantization” (İkili Niceleme) işlemine sokulabilir. Vektörleri karmaşık ondalık sayılardan sıfır ve birlere indirgeyen bu işlem, arama hızını inanılmaz derecede artırır ve bellek tüketimini minimize ederken, doğruluk kaybını yalnızca 1-2 puan seviyesinde tutar.

İkincisi ve en önemlisi “Late Chunking” (Geç Parçalama) teknolojisini standart olarak sunmasıdır. Geleneksel sistemlerde devasa bir döküman, embedding işlemine girmeden önce kelime sayısına göre rastgele parçalara bölünür. Bu durum, parçaların genel hikayeden ve bağlamdan kopmasına neden olur. Jina v5 ise 32K tokenlik dökümanın tamamını tek seferde embedding modeline sokar. Model metnin makro bağlamını anlar; örneğin ilk sayfada geçen “Ahmet Bey”in, yirminci sayfadaki “O” zamiriyle eşleştiğini öğrenir. Daha sonra bu derin bağlamla zenginleşmiş iç tokenlardan alt-vektörler (chunk embeddings) çıkarır. Bu özellik çapraz referanslı yasal belgelerde ve karmaşık analiz raporlarında Retrieval doğruluğunu radikal bir biçimde artırmaktadır.

4. GTE-Qwen2-7B-Instruct ve BGE-M3

Araştırma projeleri, bilimsel makale taramaları ve karmaşık belge kümeleri için özel tasarlanan gte-Qwen2-7B-instruct, hibrit seyrek-yoğun mimarisi sayesinde spesifik terminolojiyi yakalamada üstündür. Bu modeli farklı kılan özellik “instruction-tuned” (talimat ayarlamalı) olmasıdır. Kullanıcı sadece metin aramak yerine modele bir komut verebilir: “Bana bu doküman içinden finansal risk barındıran paragrafları bul:“. Model bu komutu aldığında, vektör uzayını spesifik bir alt-uzaya taşıyarak bağlam dışı sonuçları tamamen filtreler.

Pekin Yapay Zeka Akademisi (BAAI) imzalı BGE-M3 ise, açık kaynak dünyasının “İş Atı” (Workhorse) unvanını gururla taşır. Sadece 568 milyon parametreye sahip bu model, donanım kaynaklarının kısıtlı olduğu işletmelerde, CPU üzerinde bile düşük gecikme süreleriyle (A10G üzerinde ortalama 38ms) çalışabilmesi, 100 dil desteklemesi ve dengeli performansıyla harika bir başlangıç veya “fallback” modelidir.

Türkçe Doğal Dil İşleme, TR-MTEB ve Sektörel Analizler

Embedding mimarilerinin İngilizce ve diğer Hint-Avrupa dillerindeki küresel başarıları, iş Türkçe metinlere geldiğinde çoğu zaman ciddi pürüzlerle karşılaşmaktadır. Kurumsal Türkçe dokümanlar üzerinde çalışan geliştiricilerin en çok yakındığı sorunların başında, uluslararası modellerin Türkçe’yi tam olarak kavrayamaması gelir.

Bu problemin temel kaynağı Türkçe’nin sondan eklemeli yapısı ve yüksek üretkenliğe sahip türetimsel morfolojisidir. İngilizce’de farklı kelimelerle, koca bir cümle halinde ifade edilen bir niyet (Örneğin: “They might have been able to go”), Türkçe’de sadece yapım ve çekim ekleriyle tek bir kelimeye sığdırılabilir (“Gidebileceklerdi”). Çok dilli standart tokenizer’lar Türkçe morfolojisini bilmedikleri için bu kelimeyi anlamsız, rastgele harf öbeklerine bölerler. Bu hatalı parçalama, embedding modelinin metnin semantik bağlamını daha en baştan, vektöre dönüşmeden kaybetmesine yol açar.

Ancak 2025 ve 2026 yıllarında Türkçe NLP (Doğal Dil İşleme) ekosisteminde tarihi gelişmeler yaşanmıştır. Bu gelişmelerin en önemlisi, TR-MTEB (Turkish Massive Text Embedding Benchmark) kıyaslama setinin resmi olarak araştırmacılara sunulmasıdır. TR-MTEB, Türkçe cümle temsillerini değerlendirmek üzere ulusal kurumlar ve üniversiteler iş birliğiyle hazırlanan, kültürel duyarlılık, gramer tutarlılığı ve anlam bütünlüğü açısından insan uzmanlar tarafından filtrelenmiş 26 farklı veri setinden oluşmaktadır. Bu platform sayesinde, modellerin Türkçe okuduğunu anlama, çıkarım yapma (NLI), Türkçe belgeler içinde doğruyu bulma (Retrieval) yetenekleri şeffaf bir şekilde sıralanabilmektedir.

Optimizasyon: Chunking, Token Bütçesi ve Hibrit Arama

Dünyanın en yüksek MTEB skoruna sahip embedding modelini alıp doğrudan sunucunuza kurmak, RAG mimarilerinde başarıyı garanti etmez. Doğru vektör mimarisini yanlış veri işleme stratejileriyle beslediğinizde ortaya çıkan durum, endüstride “Çöp Giren, Çöp Çıkar” kavramıyla özetlenir. Profesyonel bir RAG sisteminin kaderini belirleyen üç büyük optimizasyon stratejisi bulunmaktadır: Parçalama (Chunking), Token yönetimi ve Yeniden Sıralama (Reranking).

- Chunking Stratejileri: Sistemlerinize yüklediğiniz pdf veya dokümanları hangi mantıkla parçaladığınız, arama sonuçlarını doğrudan etkiler. Sabit boyutlu parçalama (örneğin her 512 tokenda bir metni kesmek), bir cümlenin veya fikrin tam ortadan ikiye ayrılmasına sebep olabilir. Bu sorunu çözmek için geliştirilen Semantic Chunking, aslında arka planda devasa ve çok akıllı bir Regex yapısı kullanır. Metni kelime sayısına göre değil; cümle sonlarını, paragraf boşluklarını, bağlaçları ve noktalama işaretlerini analiz ederek anlam bütünlüğünün bozulmadığı sınırlardan keser. Bu sayede konular bütün kalır. Ancak hukuki dokümanlar veya uzun raporlar söz konusu olduğunda Semantik Chunking de yetersiz kalabilmektedir. Saha deneyimleri ve forumlarda tartışılan hukuki arama motoru kurulum senaryolarından elde edilen veriler göstermektedir ki, 30.000 tokenlik bir davası metnini küçük parçalara ayırdığınızda, metnin sonundaki “sanık”, metnin başındaki isme bağlanamaz. İşte burada Late Chunking devreye girer. Bu teknikte, uzun bağlam modelleri kullanılarak önce dokümanın tamamı okunur ve bütünleşik bir şekilde vektörize edilir. Model, dokümanın tüm hikayesine hakim olduktan sonra bu devasa vektör haritasının içinden bağlamı kaybetmemiş küçük vektörler üretir. Böylece her bir parça, büyük resmin farkında olarak veri tabanına kaydedilir.

- Token yönetimi: RAG projelerinin gizli tehlikesi, kullanıcıya sunulan cevabın maliyeti ve LLM’in dikkat süresidir. RAG spesifikasyon raporlarına göre küçük bir RAG işlemi ortalama 1000-1500 girdi tokeni harcarken, kapsamlı aramalarda bu rakam 10.000 tokene kadar çıkabilir. Müşteriye dönük bir bilgi botunuz varsa ve ayda 50.000 sorgu alıyorsa, aylık token hacminiz 200 Milyonu bulabilir. Maliyetin ötesinde bir de “Context Cliff” gerçeği vardır. Yapılan sistematik analizler, RAG sisteminin dil modeline gönderdiği referans bilgi miktarı ~2.500 tokeni (yaklaşık 4-5 standart sayfa) aştığında, model ne kadar güçlü olursa olsun cevap kalitesinin ve doğruluk oranının dramatik bir şekilde düşmeye başladığını kanıtlamıştır. Sistem bağlamın içindeki kalabalıkta asıl bilgiyi unutmaya başlar. Bu nedenle doğru embedding modelini kullanıp bağlamı 2-3 adet kesin doğru parça ile sınırlamak, çok parça getirmekten çok daha değerlidir.

- Yeniden Sıralama (Reranking): Pür vektör araması (dense vector search), anlamsal eşleştirmede mükemmeldir ancak bazen çok bariz kelimeleri kaçırabilir. Örneğin bir kullanıcı “ISO 27001 güvenlik standartları” diye arattığında, vektör araması “ISO 27001” terimini es geçip anlamsal olarak yakın olan “kurumsal güvenlik politikaları” başlıklı bir belgeyi ilk sıraya çıkarabilir. Oysa o dökümanda ISO 27001’den hiç bahsedilmiyordur. Bu sorunu çözmek için günümüzün endüstri standardı Hibrit Arama olmuştur. Sistem, arkaplanda iki ayrı motoru aynı anda çalıştırır:

- Vektör Araması: Anlamı ve niyeti yakalamak için Qwen3 veya Jina gibi embedding modellerini kullanır.

- Anahtar Kelime Araması: Sadece spesifik kelimelerin (örneğin “ISO 27001”) sıklığını sayan geleneksel motoru çalıştırır.

- Her iki sistemden dönen sonuçlar Reciprocal Rank Fusion (RRF) yöntemiyle harmanlanır. Ancak işlem burada bitmez. Bu harmanlanmış en iyi 50 sonuç, BAAI bge-reranker-v2-m3 gibi bir Cross-Encoder Reranking modeline gönderilir. Reranker modelleri, kullanıcının sorusu ile o 50 dokümanı milisaniyeler içinde tek tek karşılaştırıp bağlam uyumuna göre yeniden puanlar ve en mükemmel 5 sonucu LLM’e iletir. Saha testleri, bu hibrit ve yeniden sıralamalı mimarinin, tek başına vektör aramasının kullanıldığı sistemlere göre doğruluk oranını %9’a kadar artırdığını kanıtlamıştır.

Vektör Veritabanı (Vector DB) Seçimi ve Entegrasyon Rehberi

Seçtiğiniz Qwen3 veya Nemotron modelinin ürettiği o milyonlarca çok boyutlu sayı dizisini nerede saklayacaksınız? Geleneksel ilişkisel veritabanları (SQL sistemleri) bu vektörleri saklamak ve aralarında Kosinüs Benzerliği formülüyle hesaplama yapmak için uygun değildir; devasa veri setlerinde sistem kilitlenir. Vektör veritabanları tam da bu iş için üretilmiştir.

Bu sistemler, Yüzde Yüz Yakın Komşuluk (K-NN) formülü yerine, performans ve hızı artırmak için HNSW gibi Yaklaşık En Yakın Komşuluk (ANN) algoritmalarını kullanır. HNSW, vektörleri birbiriyle bağlantılı graf yapıları şeklinde indeksler ve arama anında alakasız dalları anında budayarak hedefe giden yolu kısaltır. Bu sayede milyonlarca kayıt arasından aradığınız belgeyi birkaç milisaniye içinde bulabilirsiniz.

Mimarinize entegre edebileceğiniz en iyi açık kaynak ve kurumsal vektör veritabanı çözümleri şunlardır:

| Veritabanı Altyapısı | Dağıtım / Hosting Türü | Öne Çıkan Özellikleri ve Kullanım Senaryosu |

|---|---|---|

| pgvector | PostgreSQL Eklentisi | Hâlihazırda PostgreSQL altyapısı kullanan ekipler için en iyisidir. 5 milyondan az vektöre sahip orta ölçekli projelerde sıfır operasyonel yük ile veri veritabanı içinde vektörizasyon sağlar. |

| Qdrant | Açık Kaynak Özel DB | Rust diliyle yazılmıştır. Kendi sunucularında yüksek performans ve güçlü “payload” filtrelemesi arayan açık kaynak meraklıları için idealdir. |

| Milvus | Kurumsal Ölçek (Enterprise) | GPU hızlandırması sunar. Yüz milyonlarca, hatta milyarlarca vektör barındıran, anlık yüksek trafik alan devasa kurumsal RAG sistemleri için üretilmiştir. |

| Pinecone | Tamamen Yönetilen SaaS | Bulut tabanlı, zero operations bir sistemdir. Sunucu altyapısıyla, Kubernetes ölçeklendirmeleriyle uğraşmak istemeyen ekiplerin ilk tercihidir. |

| Weaviate | Açık Kaynak / Hibrit DB | İçerisinde yerleşik vektörizasyon altyapısı bulunur. Dense vektör + Sparse BM25 mimarisini native olarak kusursuz yönetir. |

Sistemlerinizi tasarlarken seçeceğiniz veritabanının özellikleri kadar, donanım kaynaklarınızı da doğru analiz etmelisiniz. Örneğin Qwen3-Embedding-8B’nin ürettiği 4096 boyutlu bir vektör, BGE-M3’ün ürettiği 1024 boyutlu bir vektöre kıyasla veritabanınızın RAM’inde 4 kat daha fazla alan kaplar. İşte bu noktada, model analizinde değindiğimiz Matryoshka Representation Learning (MRL) hayat kurtarır. Vektörlerinizi anlamsal kayıp yaşamadan 4096 boyuttan 256 boyuta indirgediğinizde, Qdrant veya Milvus faturanız bir anda onda birine düşerken arama süreleriniz ışık hızına çıkacaktır.

Sıkça Sorulan Sorular

1. Embedding ve Vektör Veritabanı arasındaki fark nedir?

Bu iki kavram sıklıkla birbirine karıştırılsa da aslında birbirini tamamlayan iki farklı teknolojidir. Embedding (Gömme), bir metni, resmi veya veriyi okuyup anlayarak onu anlamsal bir sayı dizisine (vektöre) dönüştüren derin öğrenme “modelinin” (örneğin Qwen3 veya Jina v5) kendisidir. Bu model yapay zekanın duyusu ve zekasıdır. Vektör Veritabanı (örneğin Milvus, Qdrant, Pinecone) ise, embedding modeli tarafından üretilmiş olan o milyonlarca satırlık sayı dizilerini (vektörleri) kalıcı olarak saklayan, organize eden ve siz bir arama yaptığınızda bu sayılar arasında devasa bir hızla geometrik uzaklık hesaplaması (Kosinüs Benzerliği) yaparak en benzer sonucu getiren “depolama ve arama” motorudur. Biri bilgiyi sayılara çeviren analitik zeka, diğeri ise o sayıları saklayıp milisaniyeler içinde bulan hafızadır.

2. Model Boyutu artınca ne değişir, RAG performansını nasıl etkiler?

Model boyutu (dimension), vektör uzayında anlamsal haritanın ne kadar detaylı ve ince çizileceğini belirler. Örneğin 384 boyutlu küçük bir model, bir cümleyi 384 farklı özellik parametresi üzerinden incelerken; 4096 boyutlu bir Qwen3-Embedding modeli veya Nemotron, aynı metni 4096 farklı açıdan değerlendirir. Boyut sayısı arttıkça model metinler arasındaki en ince nüansları, ironiyi, alt metni ve bağlamsal farkları çok daha hassas bir şekilde yakalar; geri çağırma ve hassasiyet oranları mükemmelleşir. Ancak madalyonun diğer yüzünde maliyet vardır: Yüksek boyutlu vektörler, vektör veritabanınızda katbekat fazla RAM tüketir, arama ve matematiksel hesaplama sürelerini uzatır. Bu sebeple 2026 yılının modern sistemleri, yüksek boyuttan gelen zekayı anlamsal kayıp yaşamadan küçük boyutlara sıkıştırabilen Matryoshka Öğrenimi mimarisini standart haline getirmeye başlamıştır.

3. Açık Kaynak modeller kullanmak API maliyetlerini ne kadar düşürür?

Sistemlerinizi OpenAI, Voyage AI veya Google Gemini gibi tescilli API’ler üzerine kurduğunuzda, “token başına fiyatlandırma” duvarına çarparsınız. Kurumsal bilgi tabanınızdaki 10 milyon dokümanı ilk kez vektörize ederken binlerce dolar ödediğiniz gibi, o belgeler her güncellendiğinde, her silinip yeniden yazıldığında yeniden ve yeniden para ödemek zorunda kalırsınız. Ayrıca her kullanıcı sorgusu da bir token maliyetidir. Açık kaynak embedding modellerini kendi sunucularınıza veya kiraladığınız bir bulut sunucusuna kurduğunuzda ise bu dışa bağımlı işlem maliyetleri tamamen sıfıra iner. Kendi kontrolünüzde olan bu sistemlerde, sadece sunucu/donanım (CPU/GPU) altyapısı için sabit bir ücret ödersiniz; günde ister bin ister on milyon sorgu atın, maliyetiniz artmaz ve verileriniz şirket dışına çıkmadığı için tam bir veri güvenliği ve uyumluluk sağlamış olursunuz.