RAG tabanlı bir sistem ya da yapay zeka uygulaması geliştiriyorsanız, er ya da geç aynı noktaya gelirsiniz: “Hangi vektör veritabanını kullanmalıyım?” Araştırmaya başladığınız anda kendinizi bir seçenek bombardımanının içinde bulursunuz: Pinecone, Milvus, Qdrant, Weaviate, ChromaDB, pgvector, Turbopuffer ve daha niceleri… Liste uzayıp gider. Her biri en hızlı olduğunu söyler. Her biri en iyi ölçeklendiğini iddia eder. Hepsi geliştirici dostudur (en azından kendi anlatımlarına göre). Yayınlanan benchmark sonuçları ise çoğu zaman birbirini doğrulamaz. Gürültü artar, netlik azalır. Ve en kritik noktada, karar hâlâ size kalır.

Bu rehber tam da bu karmaşayı ortadan kaldırmak için hazırlandı. Burada pazarlama dili yok; VectorDBBench sonuçlarına dayanan performans analizleri, managed ve self-hosted çözümler arasında açık ve dürüst karşılaştırmalar ve en önemlisi, doğru tercihi yapmanızı sağlayacak net bir karar çerçevesi var.

Doğru vektör veritabanı, “en popüler olan” ya da “en çok önerilen” değildir. Sizin ihtiyaçlarınıza en iyi uyan çözümdür.

Vektör Veritabanı Nedir ve Nasıl Çalışır?

Arama motoru optimizasyonu (SEO), veri mühendisliği veya yapay zeka alanlarında çalışan profesyonellerin sıklıkla karşılaştığı “Vektör veritabanı nedir?” sorusunun yanıtı, aslında bilginin matematiksel bir uzayda nasıl temsil edildiği ile ilgilidir. Geleneksel veritabanları, verileri satırlar ve sütunlar halinde organize eder ve “tam eşleşme” prensibiyle çalışır. Örneğin, “kırmızı yazlık elbise” arandığında, veritabanı sadece içinde tam olarak bu kelimelerin geçtiği metinleri veya etiketleri bulur. Ancak kullanıcı “sıcak havalar için uygun yakut rengi giysi” diye arattığında, geleneksel sistemler aradaki anlamsal bağı kuramadığı için sonuç döndüremez.

Vektör veritabanı (Vector Database), modern yapay zeka sistemlerinin temel teknolojisidir ve yapılandırılmamış verileri (metin, görüntü, ses, video) semantik anlamı yakalayan yüksek boyutlu sayısal diziler olarak depolar. Bu yapılar, verileri içerdikleri özelliklere göre 768, 1024, 1536 veya daha yüksek boyutlu bir koordinat sistemine yerleştirir. Anlamca birbirine benzeyen veriler, bu çok boyutlu uzayda geometrik olarak birbirine yakın konumlanır.

💡 Üretime hazır bir vektör arama mimarisi kurmak sadece bir veritabanı kurmaktan ibaret değildir. Verilerin her değiştiğinde yeniden vektörleştirilmesini (embedding API çağrıları), bu isteklerin toplulaştırılmasını, API sınırlarının yönetilmesini ve gerçek ürün verilerinin (fiyat, görsel URL’si vb.) tutulduğu ayrı bir özellik deposu ile senkronizasyonunu gerektirir.

Vektör veritabanlarının çalışma mekanizması üç ana temel üzerine inşa edilir:

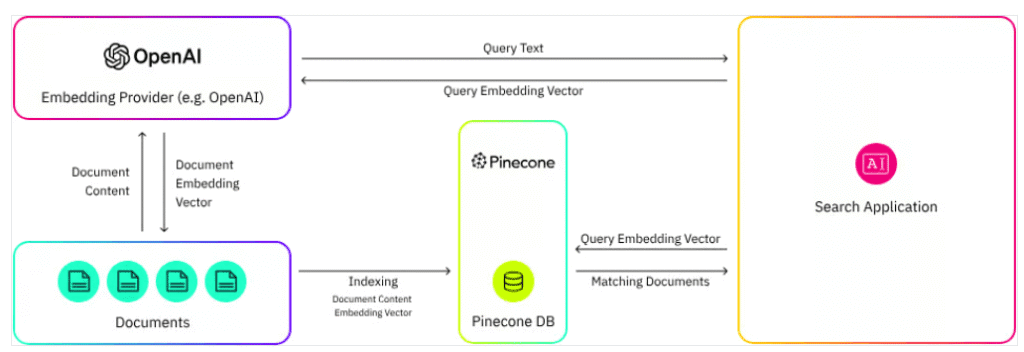

- Vektör Üretimi: Girdi verisi, OpenAI, Cohere veya Hugging Face gibi bir makine öğrenmesi modeli kullanılarak vektörlere dönüştürülür. Örneğin, Ultralytics YOLO11 gibi önceden eğitilmiş bir model kullanılarak bir resim dosyası için anında özellik yerleştirmeleri oluşturulabilir.

- İndeksleme: Oluşturulan vektörler, arama hızını artırmak için HNSW veya IVF-PQ gibi gelişmiş algoritmalarla veritabanında yapılandırılır.

- Sorgulama ve Geri Çağırma: Kullanıcı bir soru sorduğunda, bu soru da anında aynı modelle vektörleştirilir. Sistem, “Kosinüs Benzerliği” veya “Öklid Mesafesi” gibi mesafe ölçütlerini kullanarak saklanan milyonlarca vektör arasından soruya matematiksel olarak en yakın olan (en benzer) sonuçları milisaniyeler içinde getirir.

Vektör Veritabanları Ne İçin Kullanılır?

2026 yılı itibarıyla vektör veritabanları, yalnızca teknoloji startuplarının değil, geleneksel sanayi devlerinin ve finans kurumlarının da kalbine yerleşmiştir. Sektörel adaptasyon, teorik projelerin çok ötesine geçerek üretim düzeyine ulaşmıştır. İşte en yaygın üretim kullanım örnekleri:

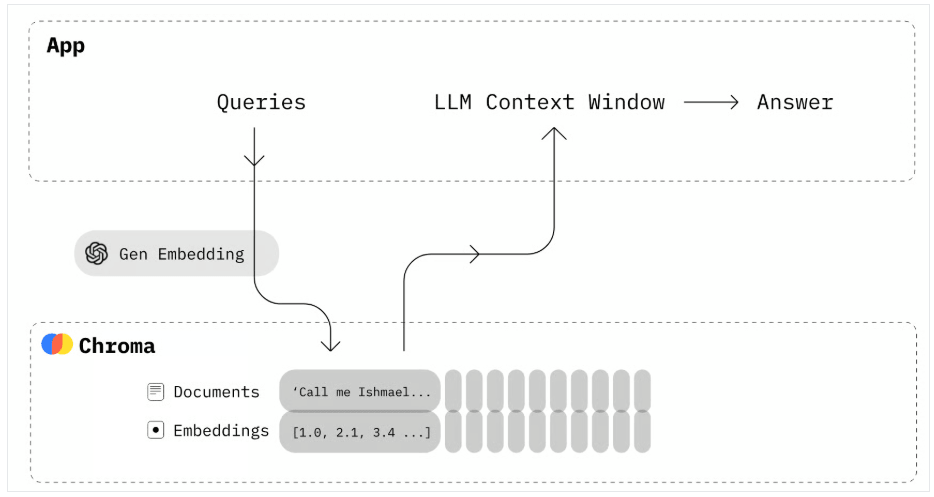

- RAG Uygulamaları: Günümüzde en popüler kullanım senaryosudur. Büyük dil modelleri, şirket içi dokümanlarınızı, ürün kataloglarınızı veya müşteri verilerinizi doğrudan bilemez. RAG yaklaşımı, ihtiyaç duyulan bilgiyi vektör veritabanından çekerek modele sunar ve böylece daha doğru, bağlama uygun yanıtlar üretilmesini sağlar. Buradaki en kritik nokta getirilen verinin kalitesi, üretilen cevabın kalitesini doğrudan belirler.

- Semantik Arama: Anahtar kelime eşleşmesi yerine kullanıcı niyetini anlamaya odaklanır. Örneğin, “geniş ayaklar için koşu ayakkabısı” arayan bir kullanıcı, ürün açıklamasında birebir bu ifade geçmese bile “geniş kalıplı spor ayakkabı” sonuçlarını görebilir. Bu yaklaşım özellikle e-ticaret sitelerinde ürün keşfini ve kurumsal platformlarda bilgiye erişimi ciddi şekilde iyileştirir.

- Finans ve Siber Güvenlikte Anormallik Tespiti: Bankacılık ve Finans sektörü, yüksek boyutlu veritabanlarını siber güvenlik ve kredi sahtekarlığı tespitinde kullanmaktadır. Ağ trafiği verileri veya kredi kartı işlem alışkanlıkları vektörel uzaya yansıtılır. Eğer bir kullanıcının anlık işlemi, geçmiş işlemlerinden elde edilen “normal davranış vektör kümesinin” çok uzağındaysa (mesafe ölçümü ile anında tespit edilir), işlem saniyenin onda biri sürede şüpheli olarak işaretlenip durdurulur.

- E-Ticaret ve Eğlence Sektöründe Öneri Sistemleri: Geleneksel “Bunu alanlar şunu da aldı” algoritmaları yerini bağlamsal vektör önerilerine bırakmıştır. Dünyanın en karmaşık servislerinden biri olan Netflix’in “Ranker” sistemi, kullanıcıların ana sayfasındaki kişiselleştirilmiş film satırlarını oluştururken devasa ölçekli vektör benzerliği algoritmaları kullanır. Sistem, izleyicinin geçmişte tükettiği içeriklerin vektörleri ile yeni aday filmlerin vektörleri arasında Kosinüs Benzerliği veya İç Çarpım uygulayarak bir “Yenilik / Beklenmediklik Skoru” hesaplar. Bu hesaplamalar milyonlarca kullanıcı için anlık yapıldığından CPU kullanımı tavan yapar. Netflix mühendisleri bu sorunu, iç içe geçmiş döngüleri optimize ederek ve modern Java Vektör API’leri kullanarak aşmış, sunucu ayak izini dramatik şekilde küçültmüştür.

- Sağlık ve Genomik : Hasta genomik dizilerini karşılaştırın, tedavi eşleştirmesi için benzer tıbbi kayıtları belirleyin veya teşhis için ilgili klinik literatürü alın. Yüksek boyutlu biyolojik veriler doğal olarak vektör gösterimlerine dönüştürülebilir.

- Doğal Dil İşleme (NLP): Gelişmiş chatbotlar, sanal asistanlar ve soru-cevap sistemleri için kritik bir bileşendir. Modelin doğru cevap verebilmesi için önce ilgili bilgiyi büyük veri havuzlarından çekmesi gerekir. Vektör veritabanları bu süreci hızlı ve doğru şekilde yönetir.

- Çok kullanıcılı yapay zeka ürünleri: Her müşterinin kendi bilgi tabanına (destek dokümanları, dahili wiki’ler, kişisel veriler) sahip olduğu SaaS uygulamaları. Her kullanıcının verileri izole bir ad alanında veya ayrı bir veritabanında bulunur ve vektör veritabanı yalnızca o müşterinin bağlamından veri alır.

Kaç Çeşit Vektör Vardır?

Teknoloji dünyasında “Kaç çeşit vektör vardır?” sorusu, ele alınan disipline göre farklı yanıtlar bulur. Temel bilgisayar bilimi ve veri analizi (örneğin R programlama dili) bağlamında incelendiğinde; atomik vektörler (mantıksal, tam sayı, gerçek sayı, karakter) ve bu yapıların üzerine inşa edilen karmaşık vektörler (faktörler, tarihler, veri çerçeveleri) karşımıza çıkar. Ancak yapay zeka, arama motorları ve vektör veritabanları ekosisteminde vektörler, “semantik yoğunluklarına” ve veri temsil biçimlerine göre üç ana kategoriye ayrılır.

Mühendislik ve veri mimarisi projelerinde hangi vektör tipinin seçileceği, doğrudan sorgu performansını, altyapı maliyetini ve kullanıcının niyetini %100 karşılama başarısını etkiler.

- Yoğun Vektörler (Dense Vectors): Derin öğrenme modelleri (LLM’ler ve Sentence Transformers) tarafından üretilen, anlamsal yapıyı en iyi kavrayan vektörlerdir. Genellikle 768, 1024 veya 1536 gibi sabit boyutlara sahiptirler ve dizideki hemen hemen her boyut, ondalıklı bir sayı barındırır.

- Özellikleri: Eşanlamlı kelimeleri, farklı dillerdeki ifadeleri ve cümle bağlamını kusursuz algılar. “Giriş bilgilerimi unuttum” ile “Şifremi sıfırlamak istiyorum” cümleleri yoğun vektör uzayında birbirine çok yakındır.

- Dezavantajları: Altyapı maliyeti (RAM ve disk alanı) yüksektir. Anahtar kelime hassasiyeti zayıftır.

- Seyrek Vektörler (Sparse Vectors): TF-IDF veya BM25 gibi algoritmalarla üretilen bu vektörler, belgeleri “token-ağırlık” eşleşmeleri olarak temsil eder. Boyutları çok yüksek olabilir (örneğin bir sözlükteki kelime sayısı kadar), ancak içlerindeki değerlerin çok büyük bir kısmı “sıfır”dır. Yalnızca belgede geçen kelimelerin ağırlığı sıfırdan büyüktür.

- Özellikleri: Tam eşleşmeler ve spesifik anahtar kelime aramalarında mükemmeldir. Örneğin; “Avustralya KDV Faturası” arandığında, sadece bu kelimeleri barındıran belgeleri öne çıkarır.

- Dezavantajları: Anlamsal kavrama (semantic understanding) yeteneği tamamen sıfırdır. Kelime farklıysa, anlam aynı olsa bile sonuç bulamaz.

- İkili ve Düşük Hassasiyetli Vektörler: 2026 yılı yapay zeka trendleri arasında donanım kaynaklarını optimize etmek en büyük önceliklerden biridir. Float32 (tek hassasiyet) yerine Float16 (yarı hassasiyet – halfvec), INT8 kuantizasyonu veya tamamen İkili formattaki vektörler kullanılarak bellek tüketimi dramatik şekilde azaltılır. Örneğin pgvector ve Elasticsearch, disk alanından ve bellek bant genişliğinden tasarruf sağlamak için bu düşük hassasiyetli vektörleri yerel olarak desteklemektedir.

| Karşılaştırma Kriteri | Yoğun Vektörler (Dense) | Seyrek Vektörler (Sparse) | İkili / Kuantize Vektörler |

| Anlam / Bağlam Algısı | Mükemmel | Yok | Yüksek (Yoğun vektör tabanlıysa) |

| Anahtar Kelime Hassasiyeti | Zayıf | Mükemmel | Zayıf |

| Üretim Teknolojisi | Makine Öğrenmesi (ML) | TF-IDF, BM25 | ML + Kuantizasyon |

| Altyapı ve Bellek Maliyeti | Çok Yüksek | Düşük | Çok Düşük (Optimizasyonlu) |

| Açıklanabilirlik (Explainability) | Düşük (Kara Kutu) | Yüksek | Düşük |

| Çok Dilli Destek (Multilingual) | Güçlü | Zayıf | Güçlü |

📌 Kurumsal saha projelerindeki uygulamalar göstermektedir ki, en başarılı arama sistemleri Yoğun ve Seyrek vektörleri aynı anda kullanan Hibrit Arama algoritmaları üzerine kurulmaktadır.

Veritabanı Türleri Nelerdir? Mimari Sınıflandırmalar

Pazardaki hızlı konsolidasyon, “Veritabanı türleri nelerdir?” sorusuna verilecek yanıtları belirli mimari felsefeler etrafında toplamıştır. Bir organizasyonun veri yönetimi uygulamaları incelendiğinde; işletmelerin %49’unun verilerinin nerede saklandığına dair tam kontrole sahip olmak istediği, %36’sının yapılandırılmamış verileri yüksek hızda yönetecek altyapılara sahip olduğu ve %16’sının halihazırda özel bir vektör veritabanı kullandığı görülmektedir. İhtiyaçlara göre üç ana veritabanı türü öne çıkmaktadır:

- Tam Yönetilen (Managed / SaaS) Vektör Veritabanları: Altyapı kurulumu, sunucu bakımı, yama yönetimi veya ölçeklendirme gibi işlemleri tamamen hizmet sağlayıcının üstlendiği (zero-ops) sistemlerdir. Pinecone gibi çözümler bu alanda başı çeker. Gecenin 3’ünde performans sorunlarını ayıklamak istemeyen ekipler için idealdir; trafik arttığında sistem otomatik olarak ölçeklenir.

- Açık Kaynaklı Vektör Veritabanları: Kodu tamamen açık olan ve şirketlerin kendi sunucularında (on-premise) veya kendi bulut hesaplarında (BYOC) barındırabildikleri sistemlerdir. Milvus, Qdrant, Chroma ve Weaviate bu kategoriye girer. Veri gizliliği regülasyonlarına (KVKK, GDPR) tabi olan ve maliyetleri kontrol altında tutmak isteyen işletmeler tarafından tercih edilir.

- Geleneksel Veritabanı Eklentileri: Şirketlerin halihazırda kullandıkları ilişkisel (SQL) veya arama motoru altyapılarına entegre edilen vektör destekleridir. Veri siloları yaratmaktan kaçınan ve operasyonel veri ile vektör verisini aynı ortamda tutmak (örneğin PostgreSQL için

pgvector, arama içinElasticsearch, önbellekleme içinRedis) isteyen mühendislik ekiplerinin favorisidir.

Aşağıdaki tablo, Amazon Web Services (AWS) altyapısında sunulan bütünleşik ve özel veritabanı türlerinin mimari özelliklerini kapsamlı bir biçimde karşılaştırmaktadır:

| AWS Çözümü / Veritabanı Türü | Temel Kullanım Senaryosu | Mimari Yapı | Desteklenen İndeksler | Sorgu Gecikmesi (Latency) |

| Amazon Kendra | Kurumsal arama ve RAG | Tam yönetilen, belge tabanlı | Otomatik | Saniyenin altında |

| Amazon OpenSearch Service | Dağıtık arama ve analitik | Dağıtık küme (Cluster) | HNSW, IVF | <10 ms (GPU Hızlandırmalı) |

| Amazon RDS (PostgreSQL/pgvector) | Vektör destekli ilişkisel veri | İlişkisel veritabanı | HNSW, IVFFlat | Değişken (Disk bağımlı) |

| Amazon MemoryDB | Gerçek zamanlı vektör arama | Bellek içi (In-memory) DB | HNSW | Ultra düşük |

| Amazon Neptune Analytics | Vektör aramalı graf analitiği | Özellik grafı (Property graph) | Yerel Graf ve Vektör | Düşük gecikme |

HNSW, IVF, PQ ve Mesafe Metrikleri

Vektör veritabanlarını geleneksel veri yapılarından ayıran devasa performans sıçraması, milyarlarca yüksek boyutlu veri noktasını tararken uygulanan “Yaklaşık En Yakın Komşu” (Approximate Nearest Neighbor – ANN) algoritmalarından kaynaklanır. Doğrusal bir arama (Flat Index / K-NN), sorgu vektörünü veritabanındaki her bir kayıtla tek tek karşılaştırır. Veri seti büyüdükçe bu işlem saatler sürebilir. Bunun yerine 2026 standartlarında şu algoritmalar endüstriyi domine etmektedir:

# İndeksleme Algoritmaları

- HNSW (Hierarchical Navigable Small World): Gelişmiş bir çok katmanlı graf algoritmasıdır. Aramaya, en üstteki “seyrek” bağlantıların bulunduğu katmandan başlar ve aşağı doğru daha yoğun katmanlara inerek hedefe ulaşır. Hız ve doğruluk oranı açısından kusursuzdur, ancak bellek tüketimi oldukça yüksektir.

- IVF (Inverted File Index): Vektör uzayını K-means gibi kümeleme algoritmalarıyla bölgelere (Voronoi hücrelerine) ayırır. Sisteme bir sorgu geldiğinde önce “kaba arama” yapılarak sorgunun hangi kümeye düştüğü bulunur, ardından sadece o kümenin içindeki vektörler taranarak “ince arama” tamamlanır.

- PQ (Product Quantization): Vektörleri sıkıştıran kayıplı (lossy) bir yöntemdir. Yüksek boyutlu bir vektörü alt bölümlere ayırır ve bu bölümleri kısa merkez referans kodlarıyla değiştirir. Böylece milyarlarca vektör GPU belleğine sığdırılabilir.

NVIDIA’nın açık kaynaklı cuVS kütüphanesi ile IVF-PQ algoritması GPU üzerinde donanım hızlandırmasıyla çalıştırıldığında, milyar ölçekli veri setlerinde hem indeks oluşturma hem de arama süreleri inanılmaz seviyelerde kısalmakta ve devasa bellek bant genişliği tam kapasite kullanılmaktadır. Ancak bu yöntem “kayıplı” olduğu için doğruluk oranında ufak düşüşler yaratabilir; yüksek hassasiyet gereken yerlerde yeniden sıralama teknikleriyle desteklenmelidir.

# Mesafe Ölçüm Metrikleri

Vektörlerin birbirine ne kadar “benzediğini” ölçmek için kullanılan matematiktir. Sistem kurulumunda altın kural; vektör veritabanındaki mesafe ölçüm metriğinin, yapay zeka modelini eğitirken kullanılan metrikle birebir aynı olması gerektiğidir.

- Kosinüs Benzerliği: Vektörlerin uzunluklarından bağımsız olarak, aralarındaki açıyı ölçer. Belgeler ve metin tabanlı NLP modelleri için en popüler seçimdir.

- Öklid Mesafesi: İki vektör arasındaki en kısa fiziksel doğrusal mesafeyi ölçer ($L_2$ normu). Bilgisayarlı görü (computer vision) projelerinde ve ses tanıma sistemlerinde yaygındır.

- İç Çarpım: İki vektörün aynı yöne bakıp bakmadığını ve uzunluklarını çarparak hesaplar. Hesaplaması çok hızlı olduğu için büyük ölçekli ve yüksek performanslı tavsiye sistemlerinde (örneğin Netflix altyapısı) sıkça tercih edilir.

2026’nın En İyi Vektör Veritabanları

Sektörel raporlar ve geliştirici anketleri, pazarın 2026 yılı itibarıyla birkaç güçlü ve spesifik çözüm etrafında konsolide olduğunu göstermektedir. Veri büyüklüğüne, operasyonel yetkinliğe ve projelerin özel gereksinimlerine göre şekillenen en iyi vektör veritabanları aşağıda detaylandırılmıştır.

1. Pinecone

Yapay zeka girişimlerinin ve RAG (Geri Getirme ile Güçlendirilmiş Üretim) uygulamalarının prototip aşamasından üretim aşamasına geçişte en sık tercih ettiği platformdur.

- 2026 Güncellemeleri ve Performans: Tamamen “Sunucusuz” bir mimariye geçiş yaparak, işlem ve depolama kaynaklarını birbirinden ayırmıştır. GPT-5 destekli yapay zeka ajanları için “Pinecone Assistant” ve yerleşik çıkarım yetenekleriyle donatılmıştır. “Sıcak” veri alanlarında p99 gecikmesi 50-100ms seviyesindedir ve saniyede 100K vektör alımı yapabilir.

- Fiyatlandırma Dinamikleri: Okuma (RU) ve Yazma (WU) üniteleri üzerinden faturalandırılır. Bir okuma ünitesi yaklaşık $0.00825 dolardır; ancak metadata filtrelemeli karmaşık sorgular 5-10 RU tüketebilir. Günde 1 milyon sorgu alan bir uygulamada, sadece okuma maliyeti aylık $250-$500 bandına ulaşabilmektedir. Hızlı pazara çıkış için mükemmeldir ancak yüksek trafiğe ulaştığında maliyetler eksponansiyel büyür.

2. Qdrant

Açık kaynak ve yönetilen bulut seçenekleriyle sunulan, tamamı Rust programlama diliyle sıfırdan yazılmışbir veritabanıdır. Mart 2026’da aldığı 50 milyon dolarlık Seri B yatırımı (Bosch, Unusual Ventures katılımlı) pazar gücünü perçinlemiştir.

- Öne Çıkan Güçleri: Vektör arama mimarisini “birleştirilebilir yapı taşları” olarak sunar. Geliştiriciler; indeksleme, puanlama, filtreleme ve sıralama mekanizmalarını tam istedikleri gibi şekillendirebilirler. 2026’daki en büyük yeniliği olan Qdrant Edge, vektör aramasını son kullanıcı cihazlarına, otonom robotlara ve mobil telefonlara taşıyan gömülü (embedded) bir hafif çözümdür.

- Kimler İçin İdeal: Tripadvisor, Canva ve Bosch gibi kurumların devasa ölçeklerinde (50M-500M vektör) çalışan, üretim düzeyinde kontrol ve altyapı maliyeti verimliliği arayan ekipler için 2026’nın favorisidir.

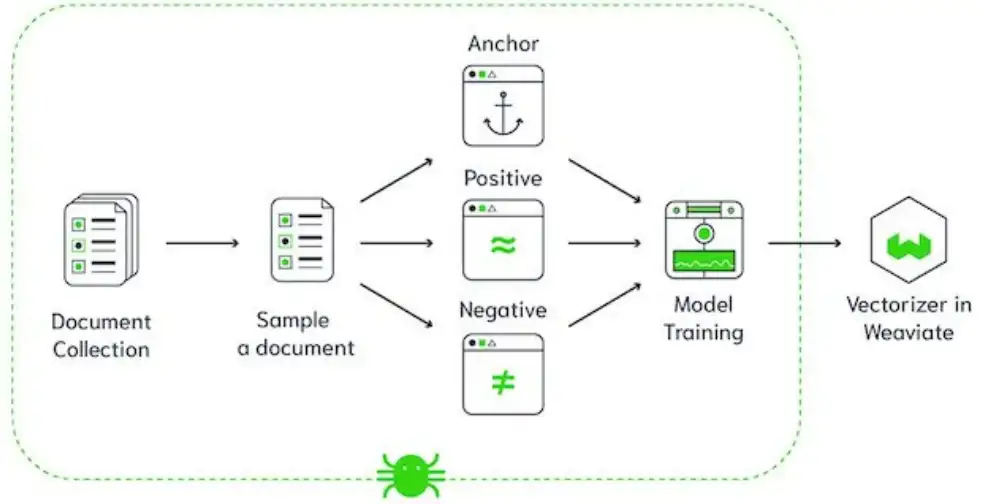

3. Weaviate

Hollanda merkezli Weaviate, yapay zeka geliştiricileri için esnek, açık kaynaklı ve modüler bir mimari sunar.

- Hibrit Arama Yeteneği: Vektör araması bağlam için mükemmel olsa da, geleneksel anahtar kelime araması kesinlik için hala gereklidir. Weaviate 1.17 sürümüyle birlikte yoğun (dense) ve seyrek vektörleri aynı anda tarayabilen yerleşik bir Hibrit Arama motoruna sahiptir. Geliştiriciler

alphaparametresini kullanarak ağırlığı ayarlayabilir:alpha=0sadece kelime araması,alpha=1sadece semantik arama,alpha=0.5ise her iki algoritmanın eşit oranda harmanlanması anlamına gelir. - Çoklu Kiracı (Multi-tenancy) İzolasyonu: Özellikle SaaS ve B2B firmaları için kritik olan bu mimaride, her bir müşterinin (kiracı) verisi izole edilmiş veri yollarından akar. Sistem performansı düşmeden milyonlarca kiracının verisi güvenle aynı küme içinde ayrıştırılabilir.

4. Chroma (ChromaDB): LLM Prototiplemede Hız Şampiyonu

Özellikle Python ekosistemi (LangChain, LlamaIndex vb.) içinde yerel yapay zeka projelerinin kalbinde yer alır. 30 milyondan fazla indirilme sayısı ile geniş bir topluluğa sahiptir.

- 2026 Rust Yeniden Yazımı (Rewrite): Geliştirici ekibi, sistemin çekirdeğini Rust diliyle yeniden yazarak (v1.0), Python’un meşhur GIL (Global Interpreter Lock) sorununu ortadan kaldırmış ve gerçek çok iş parçacıklı (multithreading) bir yapı oluşturmuştur. Bu sayede yazma ve sorgulama hızları 3 ila 5 kat (4x) artmıştır.

- Benchmark Detayları: Ancak topluluk testleri, büyük sürümler arası (v0.4.x’ten v1.3.5’e) geçişlerde bazı toplu işlem (batch) boyutlandırma anormalliklerinin yaşanabildiğini göstermektedir. Örneğin eski sürümde 5000’lik veri parçaları 3.3 saniyede işlenirken, yeni sürümde 1500’lük küçük parçaların işlenmesinin 6 saniye sürebildiği (1.8x yavaşlama) bildirilmiş olup optimizasyonlar devam etmektedir. Hızlı deneme yapmak isteyen yapay zeka mühendisleri için rakipsizdir.

5. pgvector ve pgvectorscale: PostgreSQL Eklentileri

PostgreSQL’i tamamen bağımsız bir makine öğrenmesi deposuna dönüştüren açık kaynaklı uzantılardır. Organizasyonların yeni bir teknoloji silosu kurmadan mevcut altyapılarında yapay zeka çözümleri üretmesini sağlar.

- Performans Devrimi: Timescale firmasının geliştirdiği

pgvectorscale, gelenekselpgvectorsınırlarını aşmıştır. Disk tabanlı hızlı arama sunan DiskANN algoritması ve İstatistiksel İkili Niceleme teknolojisi sayesinde; 50 milyonluk bir vektör setinde %99 doğruluk oranı ile saniyede 471 sorguya (QPS) ulaşmaktadır. Bu değer Qdrant’tan 11.4 kat daha yüksekken, Pinecone’un p95 gecikme süresine göre 28 kat daha hızlıdır. Veri mimarları için SQL sorguları (JOINS, transactions) ile vektör aramalarını aynı ortamda birleştirmek muazzam bir esneklik sunar.

6. LanceDB: Sunucusuz ve Çok Kipli Format

Yapay zeka veri hatları ve karmaşık analitik işlemleri için optimize edilmiş, depolama öncelikli bir sistemdir.

- Sütunsal (Columnar) Yenilik: Açık kaynaklı Lance formatı kullanılarak resim, metin, vektör ve metadata verilerini aynı yapıda hızlıca depolar. 2026 “Serverless by Default” (Varsayılan Olarak Sunucusuz) mimarisi ile veri depolamayı ve hesaplamayı birbirinden ayırmış, böylece sistemin boştayken “sıfıra” ölçeklenmesini sağlamıştır. Geleneksel sistemlere kıyasla Blob depolama (örneğin Amazon S3) kullanarak %100’e varan devasa maliyet tasarrufu vadeder.

7. Milvus: Milyar Ölçekli Dağıtık Mimari

Çok yüksek işlem hacmine sahip yapay zeka operasyonları için tasarlanmış kurumsal seviyede açık kaynaklı bir platformdur. Devasa ölçekteki yapay zeka operasyonlarında kesintisiz çalışma garantisi sunar. CPU ve GPU’yu aynı anda kullanabilen donanım dostu yapısı, Attu isimli açık kullanıcı arayüzü ile yönetimi kolaylaştırır. Zilliz Cloud üzerinden yönetilen bulut hizmeti de bulunur.

8. Elasticsearch ve OpenSearch: Geleneksel Arama Motorlarının Vektör Evrimi

Tam metin araması (full-text search) pazarını domine eden Elastic mimarisi, güçlü vektör yetenekleri ekleyerek yarışa dahil olmuştur.

- Performans Verileri: Zaten Elasticsearch kullanan kurumlar için en “güvenilir” seçenektir (just works). 50 milyondan fazla vektör içeren kümelerde, tam kNN aramalarında ~260ms, Yaklaşık En Yakın Komşu (ANN) kuantizasyon algoritmalarında ise 50ms’nin altında tepki süreleri sunar. Yeni bir teknoloji stakı (stack) öğrenmek istemeyen ve operasyonel stabilite arayan ekipler için uygundur.

Vektör Veritabanları Karşılaştırma Tablosu

| Veritabanı | Mimari Yapı | Performans | En Güçlü Özelliği | Zayıf Yönü | Kimler İçin Uygun | Maliyet Yapısı |

|---|---|---|---|---|---|---|

| Pinecone | Tamamen sunucusuz (serverless) | p99: 50–100ms, 100K vector/s ingest | Üretime hızlı geçiş, RAG için optimize | Yüksek trafikte maliyet hızla artar | Startup, hızlı MVP, AI agent projeleri | RU/WU bazlı (yüksek trafikte pahalı) |

| Qdrant | Açık kaynak + managed (Rust tabanlı) | Büyük veri setlerinde stabil | Modüler yapı, yüksek kontrol | Kurulum/optimizasyon karmaşık olabilir | Büyük ölçekli AI sistemleri | Düşük maliyet (self-host avantajı) |

| Weaviate | Açık kaynak, modüler | Hibrit arama performansı güçlü | Dense + sparse hybrid search | Karmaşık konfigürasyon | SaaS, multi-tenant sistemler | Orta seviye |

| Chroma (ChromaDB) | Local-first + Python odaklı | 3–5x hız artışı (Rust rewrite) | Prototiplemede en hızlı çözüm | Büyük ölçeklerde stabilite sorunları | AI geliştiricileri, hızlı test | Düşük (local kullanım) |

| pgvector + pgvectorscale | PostgreSQL eklentisi | 471 QPS (%99 doğruluk) | SQL + vector birleşimi | Kurulum teknik bilgi ister | Mevcut DB kullanan şirketler | Çok düşük (altyapı reuse) |

| LanceDB | Serverless + columnar storage | Yüksek veri işleme verimliliği | Multi-modal veri desteği | Ekosistem yeni | AI data pipeline projeleri | Çok düşük (S3 ile tasarruf) |

| Milvus | Dağıtık, GPU destekli | Milyar ölçekli veri | Ultra büyük veri yönetimi | Kurulumu ağır | Enterprise AI, big data | Orta-Yüksek |

| Elasticsearch/ OpenSearch | Geleneksel + vektör hibrit | ANN <50ms, kNN ~260ms | Mevcut sistemlerle uyum | Native vector kadar optimize değil | Mevcut Elastic kullanıcıları | Orta |

Sıkça Sorulan Sorular (SSS)

1. Vektör Veritabanı ile İlişkisel Veritabanı Arasındaki Temel Fark Nedir?

İlişkisel veritabanları (RDBMS – örn: MySQL, SQL Server) bilgileri düzenli tablolar halinde saklar ve sizin belirttiğiniz matematiksel veya mantıksal koşullara (büyüktür, küçüktür, eşittir) harfi harfine uyan verileri bulur. Eğer bir harf bile yanlış yazılmışsa veya eşanlamlı bir kelime aranmışsa sorgu başarısız olur. Vektör veritabanları (örn: Milvus, Qdrant) ise veri tabanına yüklenen metin, fotoğraf veya ses kayıtlarının “anlamını” yüksek boyutlu sayı dizileri (vektör) halinde saklar. Arama yaptığınızda sistem tam olarak yazdığınız kelimeleri değil, anlatmak istediğiniz bağlama, fikre veya görsele en çok “benzeyen” (en yakın komşu) verileri geri getirir

2. Yeni Projem İçin Hangi Vektör Veritabanı Türünü Seçmeliyim?

Mimaride karar verirken üç ana noktayı temel almanız önerilir:

- Veri Ölçeğiniz: Sadece birkaç milyon veriniz varsa Chroma veya Pinecone gibi hafif, hızlı veya yönetilen sistemler tercih edilebilir. Ancak veri tabanınız milyarlarca satıra ulaşacaksa, yüksek performanslı Milvus veya Qdrant şart.

- Mevcut Yazılım Altyapınız: Halihazırda yoğun olarak PostgreSQL veya Elasticsearch kullanıyorsanız, yeni bir veritabanı kurup verileri taşımak yerine

pgvectorscale(PostgreSQL eklentisi) veya Elasticsearch vektör eklentilerini kullanmak sistem karmaşıklığını ve hata payını sıfıra indirir. - Operasyon Bütçesi: Eğer şirketinizde altyapı yönetimi yapacak deneyimli bir DevOps ekibi yoksa, donanım satın almak yerine LanceDB Cloud veya Pinecone gibi Sunucusuz yönetilen platformlara yönelmek projeyi hızlandıracaktır.

3. HNSW Algoritması mı, Yoksa IVF-PQ Algoritması mı Daha İyidir?

Bu tamamen elinizdeki donanıma ve hassasiyet ihtiyacına bağlıdır. HNSW graf tabanlıdır, arama doğruluğu muazzamdır ancak veri kümesi büyüdükçe çok ciddi RAM (bellek) tüketir. Tıbbi tanı sistemleri veya hukuk dokümantasyonları gibi ufak sapmaların tolere edilemeyeceği alanlarda mecburidir. IVF-PQ ise vektörleri kümelere ayırıp sıkıştıran “kayıplı” bir algoritmadır. Doğruluk payı çok ufak bir miktar düşse de, bellek kullanımını inanılmaz derecede azaltır. Özellikle NVIDIA’nın donanım hızlandırmaları ile GPU üzerinde devasa veritabanlarını düşük maliyetle taramak için IVF-PQ endüstri standardı kabul edilir.