Yapay zeka modelleriyle (LLM) sohbet ederken bazen size çok emin bir dille, aslında hiç var olmayan bir bilgiyi “uydurduğuna” şahit oldunuz mu? Teknik dilde “halüsinasyon” dediğimiz bu durum, yapay zekanın en büyük zayıf noktalarından biri. Ancak RAG (Retrieval-Augmented Generation) yani “Arama ile Zenginleştirilmiş Üretim” mimarisi, bu sorunu kökten çözmek için karşımızda duruyor. Peki, RAG tam olarak nedir ve işletmenizin ya da projenizin yapay zeka çıktılarını nasıl daha güvenilir hale getirir?

RAG Nedir?

RAG (Retrieval-Augmented Generation), büyük dil modellerinin (LLM) yetersiz kaldığı noktalarda devreye giren, onları gerçek ve güncel verilerle besleyen bir yaklaşımdır. Temel fikir şu: Bir dil modeli soruya cevap üretmeden önce, ilgili belgeleri veya veri kaynaklarını arayıp bulur, sonra bu bilgileri kullanarak cevap oluşturur. Standart bir dil modelinin eğitim verisi belirli bir tarihte kesilir. Yani model, 2024 sonrası gelişmeleri bilmez; şirketinizin iç dokümanlarına erişemez; güncel fiyat bilgisi veremez. RAG bu kısıtlamayı ortadan kaldırır.

Peki fark neden bu kadar büyük? Şöyle düşünebilirsiniz: Standart bir yapay zeka modelini, çok zeki ama her şeyi ezberinden söyleyen bir öğrenciye benzetebilirsiniz. Eğer öğrenci o konuyu o an hatırlamıyorsa, mantıklı görünen ama yanlış bir cevap üretebilir. RAG mimarisi ise bu öğrencinin önüne devasa bir kütüphane ve güncel kaynaklar koymaktır. Soru geldiğinde yapay zeka önce kütüphaneye gider, ilgili kaynakları bulur, okur ve ardından size cevap verir. Yani RAG, yapay zekayı bir “ezberci” olmaktan çıkarıp, “araştırmacı” bir asistana dönüştürür.

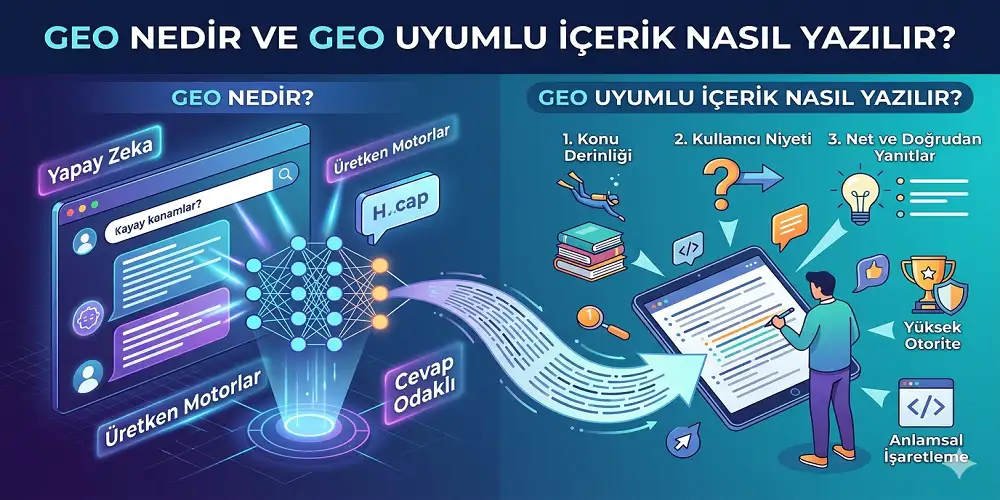

RAG Mimarisi Nasıl Çalışır?

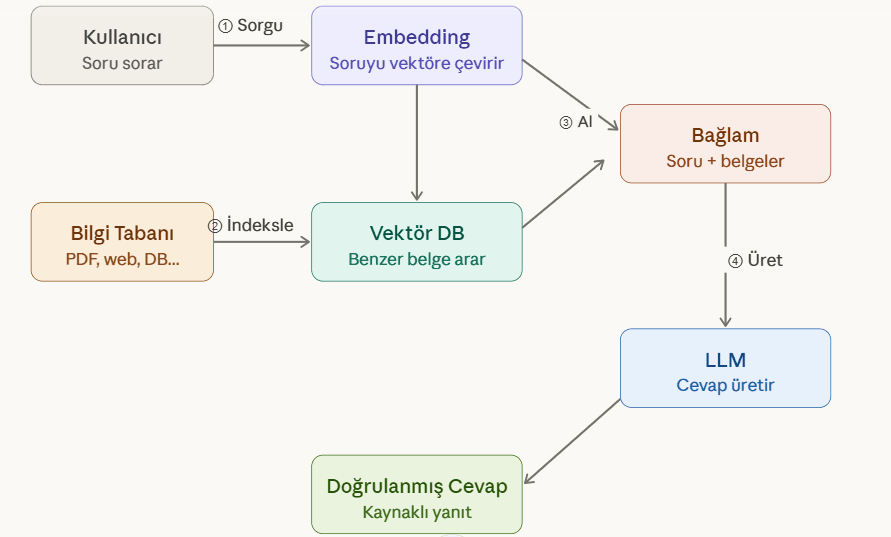

RAG’ın çalışma prensibi, verinin ham halinden anlamlı bir cevaba dönüşme yolculuğudur. İşte o süreç:

- Veri Hazırlığı (Chunking & Embedding): Elinizdeki dokümanlar (PDF, web sitesi, veritabanı) küçük parçalara bölünür ve yapay zekanın anlayacağı sayısal değerlere (vektörlere) dönüştürülür.

- Vektör Veritabanı: Bu sayısal değerler bir veritabanında saklanır.

- Arama (Retrieval): Siz bir soru sorduğunuzda, sistem kütüphanedeki en alakalı bilgi parçalarını saniyeler içinde bulur.

- Zenginleştirme (Augmentation): Bulunan bu güncel bilgiler, sorunuzla birleştirilerek yapay zekaya (LLM) gönderilir.

- Üretim (Generation): Yapay zeka artık elindeki bu taze kanıtları kullanarak size %100 doğru ve güncel bir cevap hazırlar.

RAG Mimarisinin Temel Bileşenleri

RAG sistemi kurmak istiyorsanız birkaç kritik bileşeni doğru seçmeniz gerekiyor. Bunları kısaca inceleyelim:

- Belge İşleme- Ham verileriniz (PDF’ler, Word dosyaları, web sayfaları, veritabanı kayıtları) önce parçalara bölünür (chunking). Bu parçaların ne kadar büyük olacağı önemli. Çok küçük parçalar bağlamı kaybettirebilir; çok büyük parçalar ise işlem maliyetini artırır ve ilgisiz bilgi taşıyabilir. Genellikle 256–512 token aralığı iyi bir başlangıç noktasıdır.

- Embedding Modeli– Belgeler ve kullanıcı soruları, anlam vektörlerine dönüştürülür. Türkçe içerikler için çok dilli embedding modelleri (multilingual-e5, paraphrase-multilingual-mpnet gibi) tercih edilmeli. İngilizce odaklı modeller Türkçede anlam kayıplarına yol açabilir.

- Vektör Veritabanı– Embedding’ler burada saklanır ve hızlı benzerlik araması yapılır. Pinecone, Weaviate, Qdrant, Milvus ve pgvector en yaygın tercihler arasında. Her birinin farklı ölçek ve maliyet profili var; projenizin büyüklüğüne göre seçim yapmalısınız.

- Retrieval (Geri Getirme) Stratejisi– Basit vektör benzerliği her zaman yetmeyebilir. Hibrit arama, yani vektör araması ile anahtar kelime aramasını (BM25) birleştirmek çok daha iyi sonuçlar verir. Ayrıca re-ranking (getirilen belgeleri ikinci bir modelle yeniden sıralamak? doğruluk oranını ciddi ölçüde artırır.

- LLM (Büyük Dil Modeli)– Tüm bu hazırlık, sonunda cevabı üretecek modele teslim edilir. GPT-4o, Claude, Gemini ya da açık kaynak modeller tercih edilebilir. Önemli olan, modelin sisteme verilen bağlamı iyi kullanabilmesi.

RAG ile Doğruluk Oranını Artırmak İçin 7 Pratik Yöntem

Sadece bir RAG sistemi kurmak yetmez; onu optimize etmek gerekir. İşte doğruluğu zirveye taşıyacak stratejiler:

- Chunk boyutunu optimize edin. 512 token ile başlayın, sonra kaliteyi ölçün. Karmaşık teknik belgeler için daha büyük, sık tekrarlanan bilgiler için daha küçük parçalar deneyin.

- Metadata ekleyin. Her belge parçasına kaynak adı, tarih, kategori gibi metadata eklemeniz, hem sıralama kalitesini artırır hem de modele kaynaklı cevap üretme imkânı tanır.

- Hibrit arama kullanın. Yalnızca vektör benzerliğine güvenmeyin. Özellikle özel isimler, kodlar veya teknik terimler içeren sorgularda BM25 gibi geleneksel arama yöntemleri belirleyici olabilir.

- Re-ranking uygulayın. Getirilen ilk 10–20 belgeyi bir cross-encoder modeli ile yeniden sıralayın. Bu adım, alakasız belgelerin modele girmesini önler.

- Query expansion / HyDE deneyin. HyDE (Hypothetical Document Embeddings) yönteminde model önce varsayımsal bir cevap üretir, sonra bu varsayımsal cevabın vektörü ile arama yapılır. Belirsiz veya kısa sorgularda işe yarar.

- Cevabı kaynakla ilişkilendirin. Model, cevabın her bölümünü hangi kaynaktan ürettiğini belirtecek şekilde yönlendirin. Bu hem kullanıcı güvenini artırır hem de hatalı üretimi izlemenizi kolaylaştırır.

- Değerlendirme döngüsü kurun. RAGAS gibi çerçeveler kullanarak faithfulness (sadakat), context recall ve answer relevance gibi metrikleri düzenli ölçün. Kör uçuşla sistem iyileştirmek mümkün değil.

RAG ile Klasik Fine-Tuning Arasındaki Fark

Çoğu zaman insanlar şunu soruyor: “Modeli eğitip özelleştirmek varken neden RAG kullanalım?” İkisi aslında birbiriyle rekabet etmiyor; farklı sorunları çözüyor.

| Kriter | RAG | Fine-Tuning |

|---|---|---|

| Güncel veri | ✅ Her zaman güncel | ❌ Yeniden eğitim gerekir |

| Şeffaflık | ✅ Kaynaklar gösterilebilir | ❌ Neden bildiğini açıklamak zor |

| Maliyet | ✅ Düşük (inference zamanı) | ❌ Yüksek (eğitim maliyeti) |

| Gizli veri | ✅ Veri modele yüklenmez | ❌ Hassas veri eğitime girer |

| Tarz/kişilik | ❌ Sınırlı | ✅ Güçlü |

| Alan jargonu | Orta | ✅ Güçlü |

Pratikte en iyi sonucu veren yaklaşım, ikisini birleştirmek: Modeli alan jargonu için fine-tune edin, güncel ve spesifik bilgi için RAG kullanın.

💡 Verilerinizi vektörleştirirken parçaların (chunk size) ne kadar büyük olacağına dikkat edin. Çok büyük parçalar odak noktasını dağıtır, çok küçük parçalar ise bağlamı koparır. Genelde 512 veya 1024 karakterlik, birbiriyle hafif kesişen (overlap) parçalar en iyi sonucu verir.

RAG Nerede Kullanılır?

RAG mimarisinin hayata geçirildiği en yaygın kullanım alanları şunlar:

- Kurumsal bilgi tabanı asistanları: Çalışanların iç politikalar, prosedürler veya teknik belgeler hakkında sorular sorduğu sistemler. Geleneksel arama motorlarına kıyasla çok daha doğal ve bütüncül cevaplar sunar.

- Hukuk ve uyum (compliance) sistemleri: Sözleşme analizi, mevzuat takibi veya risk değerlendirmesi gibi alanlarda gerçek belgelere atıfla cevap üretilmesi kritiktir; hallüsinasyon kabul edilemez.

- Müşteri destek botları: Ürün kılavuzları, SSS dökümanları ve destek geçmişi kullanılarak çok daha doğru ve kişiselleştirilmiş cevaplar oluşturulabilir. RAG mimarisinin modern Chatbot sistemleri ve NLP teknolojisi ile entegre edilmesi, müşteri hizmetleri deneyimini standart bir otomatik yanıttan çıkarıp uzman bir asistan seviyesine taşır.

- Sağlık ve klinik uygulamalar: Güncel kılavuzlar, ilaç bilgileri ve hasta kayıtlarına dayalı karar destek sistemleri. Burada doğruluk hayati önem taşıdığından RAG’ın kaynak şeffaflığı büyük avantaj sağlar.

- E-ticaret ürün sorgulama: Binlerce ürün arasından kullanıcının niyetine en uygun olanı bulmak ve detaylı karşılaştırma sunmak.

Sıkça Sorulan Sorular (SSS)

Hiçbir teknoloji %100 garanti vermez ancak RAG, halüsinasyonları minimuma indirir. Güvenilir bir bilgi tabanı ve iyi kurulmuş bir retrieval pipeline ile hallüsinasyon oranını %80–90 oranında düşürmek mümkündür. Kritik uygulamalarda cevapları doğrulayan bir post-processing katmanı eklemek de iyi bir pratiktir. Eğer sistem “Bilmiyorum” diyebiliyorsa, bu onun doğru çalıştığını gösterir. Yanlış bilgi uydurmasındansa, kaynakta bulamadığı bilgi için “Bilmiyorum” demesi güvenilirlik açısından çok daha değerlidir.

Temel bir RAG sistemi artık birkaç satır kodla kurulabiliyor; LlamaIndex veya LangChain gibi kütüphaneler süreci büyük ölçüde soyutluyor. Ancak prodüksiyon kalitesinde bir sistem için embedding seçimi, chunk stratejisi, vektör DB yönetimi ve değerlendirme döngüsü konularında deneyim gerekiyor. Orta düzey bir yazılım geliştirici ve bir veri mühendisi ile sağlam bir sistem kurulabilir.

Kesin bir cevap yok; kullanım senaryonuza göre değişiyor. Küçük ve orta ölçekli projeler için Qdrant veya pgvector (PostgreSQL eklentisi olarak) pratik ve maliyet avantajlı. Büyük ölçek ve yüksek sorgu hacmi için Pinecone veya Weaviate güçlü seçenekler. Tamamen açık kaynak tercih ediyorsanız Milvus da olgun bir alternatif.

Kesinlikle evet ve bu aslında en iyi pratik olarak kabul ediliyor. Fine-tuning ile modeli belirli bir alanın dilini, tarzını ve kavramlarını iyi öğretebilirsiniz. RAG ile ise bu modeli güncel, spesifik ve gizli verilere bağlarsınız. İkisinin birlikte kullanımı özellikle hukuk, sağlık ve finans gibi uzmanlık gerektiren alanlarda çok güçlü sonuçlar veriyor.

RAGAS (RAG Assessment) çerçevesi bu konuda fiilî standart haline geldi. Dört temel metriği ölçüyor: faithfulness (modelin ürettiği cevabın belgelerle ne kadar örtüştüğü), answer relevance (cevabın soruya ne kadar uygun olduğu), context precision (getirilen bağlamın ne kadarının gerçekten kullanıldığı) ve context recall (doğru cevap için gereken bilgilerin ne kadarının getirildiği). Bu metrikleri düzenli ölçmeden sistemi güvenle iyileştirmek mümkün değil.